ETH entwickelt Chip gegen Deepfakes

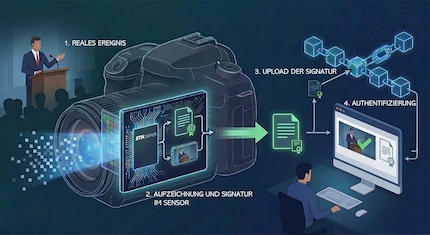

Ein Projekt der ETH Zürich versieht Fotos und Videos auf Hardwareebene mit einer kryptografischen Signatur. Diese soll sich später dezentralisiert auslesen lassen. So könnten Plattformen echte Aufnahmen automatisiert verifizieren.

Gefälschte Videos und Bilder von Politikerinnen, Promis oder dem Papst: Deepfakes sind längst kein technischer Gag mehr, sondern ein Geschäftsmodell für Betrug und ein Risiko für die Demokratie. Miss- und Desinformation steigen, während die Gegenmassnahmen kaum hinterherkommen. Das hat zur Folge, dass viele Leute auch glaubwürdigen Quellen nicht mehr trauen.

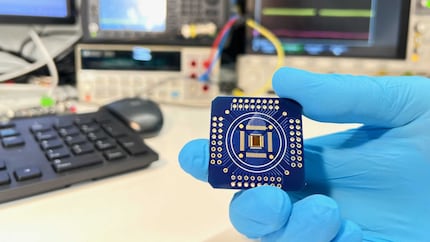

Forschende der ETH Zürich wollen diesem Problem mit einer Hardwarelösung entgegenwirken. Sie haben einen Bildsensor entwickelt, der seine Daten direkt im Chip kryptografisch signiert und so nachträgliche Manipulationen sichtbar macht. Echte Aufnahmen können von jedem und jeder verifiziert werden.

Dezentralisierte Verifikation per Blockchain

Der Prototyp erzeugt bei einer Videoaufnahme nicht nur die Bilddaten, sondern gleichzeitig eine digitale Signatur. Sie ist fest mit dem jeweiligen Sensor verknüpft. Sie dokumentiert, von welchem Chip die Daten stammen und zu welchem Zeitpunkt sie entstanden sind. Jede spätere Änderung am Bildmaterial würde die Signatur ungültig machen. Um ein Deepfake zu erzeugen, das als «echt» durchgeht, müssten Angreifer die Hardware selbst kompromittieren – also den Chip physisch angreifen. Dieser Aufwand wäre so hoch, dass Fälschungen für soziale Medien wirtschaftlich unattraktiv würden.

Quelle: Felix Franke / ETH Zürich

Kamerahersteller könnten die vom Chip erzeugten Signaturen in einem öffentlichen Register auf Blockchain-Basis ablegen. Plattformen oder Prüfwerkzeuge gleichen beim Upload oder bei einer Verifikation die Signatur der Datei mit dem Register ab. Stimmt sie überein, gilt der Inhalt als authentische Aufnahme. Fehlt der Eintrag oder passt er nicht, ist das ein Warnsignal. Die Vertrauenskette soll sich damit weg von Plattformen und Software hin zur Hardware verschieben.

Heutige Erkennungsverfahren suchen Fakes meist anhand von Spuren von KI-Generierung im Bild – etwa unnatürliche Artefakte oder inkonsistente Lichtverhältnisse. Im Unterschied dazu arbeitet der ETH-Ansatz nicht mit Wahrscheinlichkeiten, sondern mit verlässlichen Herkunftsnachweisen. Für Plattformen wie YouTube oder soziale Netzwerke, die bereits Deepfake-Meldesysteme für Politikerinnen und Journalisten testen, könnte der Chip automatisiert Inhalte verifizieren.

Tiefere Integration als bisherige Ansätze

Noch ist der Sensor ein Prototyp. Das Konzept funktioniert für beliebige Sensortypen, von Fotokameras bis Smartphones. Für einen breiten Einsatz müssten Hersteller ihre Geräte anpassen und sich auf gemeinsame Registerstandards einigen. Ob das realistisch ist, bleibt offen. Hersteller wie Sony, Canon, Adobe und Microsoft verfolgen bisher einen Ansatz auf Softwareebene, um die Echtheit von Fotos zu verifizieren: C2PA ist ein offener Standard zur kryptografischen Signatur von Metadaten. Einige Kameras unterstützen ihn bereits.

Quelle: Caroline Arndt Foppa / ETH Zürich

Die ETH-Lösung geht tiefer. Sie verlagert die Erzeugung der Signatur in den Chip und verknüpft so auf Hardwareebene das reale Ereignis mit der digitalen Datei. Rohdaten und Signatur sind untrennbar miteinander verbunden. Der zweite Unterschied liegt in der Idee des dezentralisierten Registers. Damit spielt es keine Rolle, ob ein an der Verarbeitung oder Übertragung der Daten beteiligtes Unternehmen vertrauenswürdig ist.

Mein Fingerabdruck verändert sich regelmässig so stark, dass mein MacBook mich nicht erkennt. Der Grund: Sitze ich nicht vor einem Bildschirm oder stehe hinter einer Kamera, hänge ich oft an den Fingerspitzen in einer Felswand.

Vom neuen iPhone bis zur Auferstehung der Mode aus den 80er-Jahren. Die Redaktion ordnet ein.

Alle anzeigen