Neues KI-Modell gefährdet und erhöht die IT-Sicherheit zugleich

Anthropics neues KI-Modell Mythos soll IT-Sicherheitslücken dermassen gut erkennen und ausnutzen können, dass es gar nicht veröffentlicht wird. Steckt dahinter mehr als nur eine PR-Aktion?

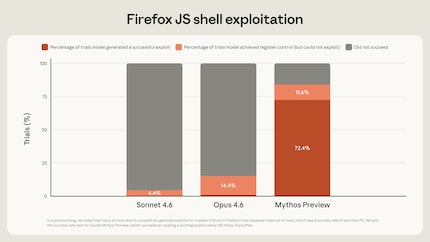

Anthropic hat ein neues KI-Modell namens Claude Mythos Preview (kurz: Mythos) entwickelt. Es ist ein Large Language Model (LLM) für allgemeine Zwecke, laut Anthropic jedoch besonders stark darin, IT-Sicherheitslücken zu entdecken. Mythos soll bereits Tausende von schwerwiegenden, bislang unbekannten Schwachstellen gefunden haben, darunter auch solche, die sich in allen grösseren Betriebssystemen und Webbrowsern befinden.

Mythos kann laut Anthropic die Sicherheitslücken nicht nur ausfindig machen, sondern teilweise auch beheben. Andererseits programmiert das Tool auf Verlangen auch funktionierende Exploits, also Code, der die Schwachstelle tatsächlich ausnutzt. Mythos hat somit das Potenzial, die IT-Sicherheit massiv zu verbessern – aber auch immensen Schaden anzurichten, sollte es in falsche Hände geraten.

Quelle: Anthropic

Das Modell ist zurzeit nicht für die Allgemeinheit zugänglich. Stattdessen hat Anthropic Project Glasswing ins Leben gerufen: Ausgewählte Akteure erhalten Zugriff, um Sicherheitsprobleme zu beheben.

Darunter befinden sich mit Apple, Google, Microsoft und der Linux Foundation die Entwickler der wichtigsten Betriebssysteme und Webbrowser. Mit dabei sind auch Amazon Web Services, Anthropic, Broadcom, Cisco, Crowdstrike, JPMorgan Chase, Nvidia und Palo Alto Networks. Und über 40 weitere, nicht mit Namen genannte Unternehmen und Organisationen.

Eindrückliche Beispiele

Mythos findet auch Sicherheitslücken in Software, die als besonders sicher gilt und unzählige Male geprüft wurde. Als Beispiel nennt Anthropic einen Bug im Betriebssystem OpenBSD, der offenbar 27 Jahre lang unentdeckt blieb. Dabei genügt eine Remote-Verbindung, um einen Rechner zum Absturz zu bringen. OpenBSD wird wegen seiner hohen Sicherheit häufig für Server und Firewalls eingesetzt.

Ein weiteres Beispiel betrifft die Video-Software FFmpeg. Ein Bug darin sei trotz millionenfacher automatischer Sicherheits-Scans 16 Jahre lang nicht entdeckt worden. Ein drittes Beispiel betrifft den Linux-Kernel. Eine Kombination mehrerer Lücken ermöglicht laut Anthropic, die komplette Kontrolle über den Rechner zu erlangen.

Da diese Schwachstellen inzwischen behoben sind, hat Anthropic dazu technische Details veröffentlicht.

Es bleiben offene Fragen

Anthropic will in diesem Herbst an die Börse gehen und braucht dafür Kapital. Der vorliegende Bericht muss auch in diesem Licht gelesen werden: Als Hinweis an potenzielle Investoren, dass Anthropic die krassesten Tools entwickelt. Doch die gezeigten Beispiele sind eindrücklich und die Behauptung, dass Mythos in Sachen IT-Sicherheit besonders leistungsfähig ist, wirkt insgesamt glaubwürdig.

Dass das Tool derzeit nicht veröffentlicht wird, dürfte ebenfalls eine gute Entscheidung sein. Ein Tool, das auf einen Schlag Tausende von gravierenden Sicherheitslücken entlarvt, darf auf keinen Fall in falsche Hände geraten. Beheben die Entwickler nun die Schwachstellen schnell, kann es hingegen die Sicherheit sogar erhöhen.

Zu diesem Punkt gibt es aber mehrere offene Fragen. Zum einen, ob die Software wirklich unter Verschluss gehalten werden kann. Und ob Anthropic das überhaupt will – schliesslich wurde Mythos nicht als Sicherheitstool entwickelt, sondern als Allzweck-KI zur breiten Verwendung. Doch selbst wenn Mythos unveröffentlicht bleibt, dürften Konkurrenzmodelle schon bald auf einem ähnlichen Niveau sein. Ausserdem ist denkbar, dass zum Beispiel Geheimdienste bereits KI-Modelle haben, die Ähnliches leisten. In jedem Fall tun die Entwickler gut daran, jetzt Vollgas bei der Behebung der Lücken zu geben.

Wie immer in solchen Fällen ist nicht klar, ob die entdeckten Schwachstellen nur den Entwicklern unbekannt sind oder der gesamten Menschheit. Viele Zero-Day-Lücken werden unter Verschluss gehalten und teuer auf dem Schwarzmarkt verkauft. An diesem Markt operieren nicht nur Kriminelle, sondern auch Geheimdienste oder die Polizei (Stichwort Staatstrojaner). Wenn wir davon ausgehen, dass etliche dieser Schwachstellen im Untergrund bereits bekannt sind, vielleicht sogar mit funktionierenden Exploits, dann müsste dieses KI-Tool eine Verbesserung der Sicherheit bedeuten.

Gibt es gar ein Verbot?

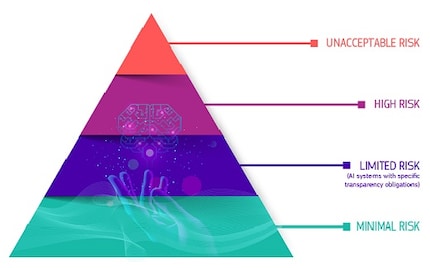

Und schliesslich stellt sich die Frage nach einer staatlichen Regulierung. Die KI-Verordnung der EU teilt KI-Anwendungen in verschiedene Risikostufen ein. Die bislang für gewöhnliche User zugänglichen Tools gelten als Beispiele für die zweitniedrigste Stufe «begrenztes Risiko», womit ausser einer Transparenzpflicht keine weiteren Auflagen verbunden sind. Doch hier könnte das anders aussehen. Ich bin kein Jurist, aber nach meinem Verständnis fällt eine KI, mit der sich ohne besondere Kenntnisse kritische Infrastruktur angreifen lässt, in die Stufe «inakzeptables Risiko» – was ein Verbot zur Folge hätte.

Quelle: digital-strategy.ec.europa.eu

Durch Interesse an IT und Schreiben bin ich schon früh (2000) im Tech-Journalismus gelandet. Mich interessiert, wie man Technik benutzen kann, ohne selbst benutzt zu werden. Meine Freizeit ver(sch)wende ich am liebsten fürs Musikmachen, wo ich mässiges Talent mit übermässiger Begeisterung kompensiere.

Interessantes aus der Welt der Produkte, Blicke hinter die Kulissen von Herstellern und Portraits von interessanten Menschen.

Alle anzeigen